Thai - Wikilangs Models

Comprehensive Research Report & Full Ablation Study

This repository contains NLP models trained and evaluated by Wikilangs, specifically on Thai Wikipedia data. We analyze tokenizers, n-gram models, Markov chains, vocabulary statistics, and word embeddings.

📋 Repository Contents

Models & Assets

- Tokenizers (8k, 16k, 32k, 64k)

- N-gram models (2, 3, 4, 5-gram)

- Markov chains (context of 1, 2, 3, 4 and 5)

- Subword N-gram and Markov chains

- Embeddings in various sizes and dimensions (aligned and unaligned)

- Language Vocabulary

- Language Statistics

Analysis and Evaluation

- 1. Tokenizer Evaluation

- 2. N-gram Model Evaluation

- 3. Markov Chain Evaluation

- 4. Vocabulary Analysis

- 5. Word Embeddings Evaluation

- 6. Morphological Analysis (Experimental)

- 7. Summary & Recommendations

- Metrics Glossary

- Visualizations Index

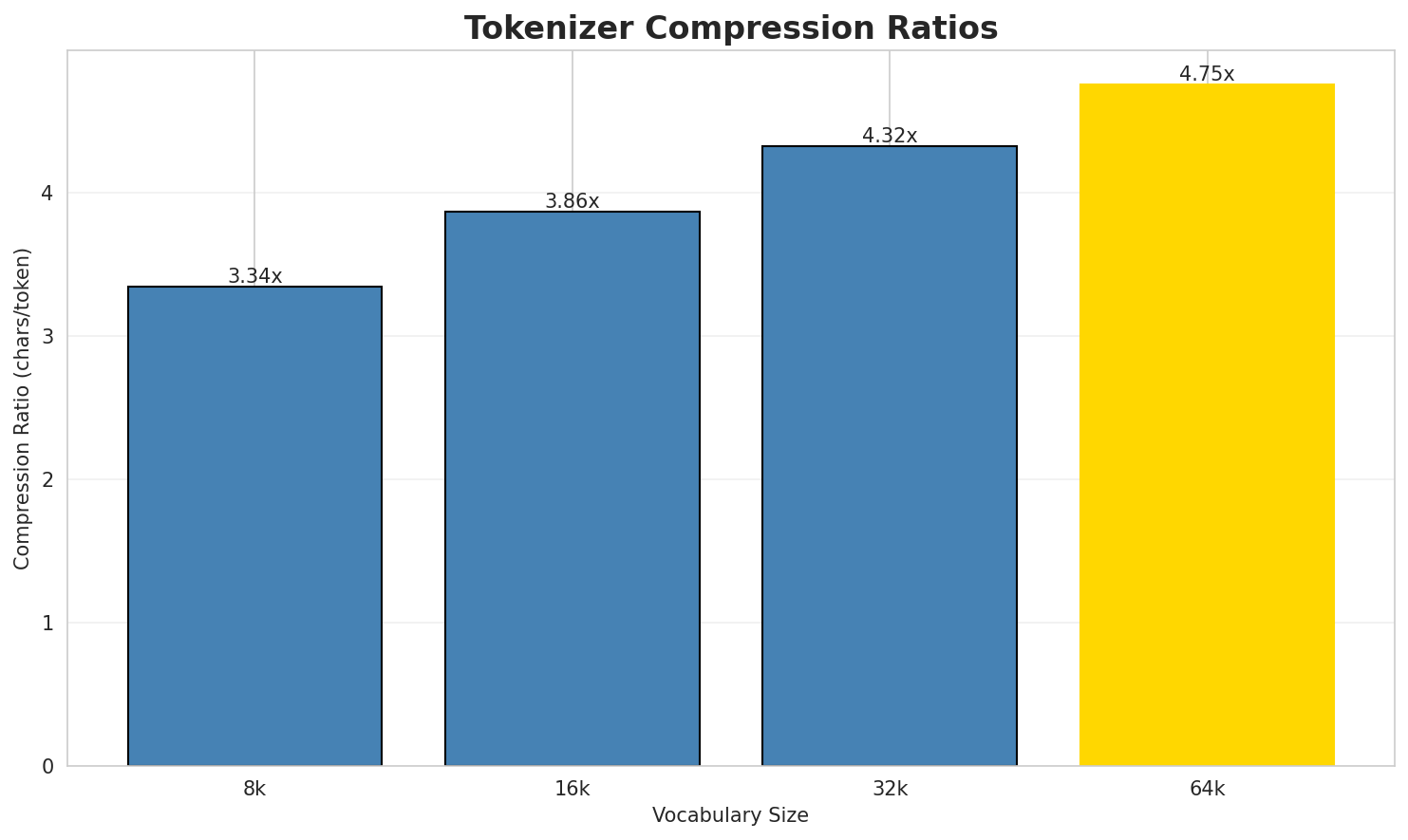

1. Tokenizer Evaluation

Results

| Vocab Size | Compression | Avg Token Len | UNK Rate | Total Tokens |

|---|---|---|---|---|

| 8k | 3.339x | 3.36 | 0.1132% | 2,229,178 |

| 16k | 3.862x | 3.88 | 0.1309% | 1,927,473 |

| 32k | 4.323x | 4.35 | 0.1466% | 1,722,046 |

| 64k | 4.749x 🏆 | 4.78 | 0.1610% | 1,567,500 |

Tokenization Examples

Below are sample sentences tokenized with each vocabulary size:

Sample 1: ไลฟ์การ์ดแห่งหาดบอนได เป็นสารคดีจากออสเตรเลียนำเสนอการทำงานตลอด 24 ชั่วโมงของไลฟ...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁ไล ฟ์ การ์ ด แห่ง หาด บอน ได ▁เป็น สาร ... (+24 more) |

34 |

| 16k | ▁ไล ฟ์ การ์ด แห่ง หาด บอน ได ▁เป็นสาร คดี จาก ... (+19 more) |

29 |

| 32k | ▁ไลฟ์ การ์ด แห่ง หาด บอน ได ▁เป็นสาร คดี จาก ออสเตร ... (+18 more) |

28 |

| 64k | ▁ไลฟ์ การ์ด แห่ง หาด บอน ได ▁เป็นสาร คดี จาก ออสเตรเลียน ... (+17 more) |

27 |

Sample 2: 32 อาจหมายถึง: 32 (ตัวเลข) 32 ก่อนคริสตศักราช, 32, และอื่นๆ 32 (เพลง) ,เพลงในปี ...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁ 3 2 ▁อาจหมายถึง : ▁ 3 2 ▁( ตัว ... (+28 more) |

38 |

| 16k | ▁ 3 2 ▁อาจหมายถึง : ▁ 3 2 ▁( ตัวเลข ... (+27 more) |

37 |

| 32k | ▁ 3 2 ▁อาจหมายถึง : ▁ 3 2 ▁( ตัวเลข ... (+25 more) |

35 |

| 64k | ▁ 3 2 ▁อาจหมายถึง : ▁ 3 2 ▁( ตัวเลข ... (+24 more) |

34 |

Sample 3: Molopanthera เป็นสกุลของพืชดอกที่อยู่ในวงศ์ Rubiaceae. ถิ่นกำเนิดของมันคือ บราซิ...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁m ol op anth era ▁เป็นสกุลของ พืชดอก ที่อยู่ในวงศ์ ▁r ub ... (+24 more) |

34 |

| 16k | ▁mol op anthera ▁เป็นสกุลของ พืชดอก ที่อยู่ในวงศ์ ▁rub iaceae . ▁ถิ่นกําเนิด ... (+17 more) |

27 |

| 32k | ▁mol op anthera ▁เป็นสกุลของ พืชดอก ที่อยู่ในวงศ์ ▁rubiaceae . ▁ถิ่นกําเนิด ของมันคือ ... (+14 more) |

24 |

| 64k | ▁mol op anthera ▁เป็นสกุลของ พืชดอก ที่อยู่ในวงศ์ ▁rubiaceae . ▁ถิ่นกําเนิด ของมันคือ ... (+14 more) |

24 |

Key Findings

- Best Compression: 64k achieves 4.749x compression

- Lowest UNK Rate: 8k with 0.1132% unknown tokens

- Trade-off: Larger vocabularies improve compression but increase model size

- Recommendation: 32k vocabulary provides optimal balance for production use

2. N-gram Model Evaluation

Results

| N-gram | Variant | Perplexity | Entropy | Unique N-grams | Top-100 Coverage | Top-1000 Coverage |

|---|---|---|---|---|---|---|

| 2-gram | Word | 56,310 | 15.78 | 475,306 | 16.2% | 28.1% |

| 2-gram | Subword | 2,438 🏆 | 11.25 | 124,885 | 27.9% | 71.1% |

| 3-gram | Word | 160,871 | 17.30 | 713,993 | 10.6% | 19.4% |

| 3-gram | Subword | 27,338 | 14.74 | 1,000,290 | 10.1% | 31.1% |

| 4-gram | Word | 529,813 | 19.02 | 1,376,813 | 3.4% | 10.2% |

| 4-gram | Subword | 174,441 | 17.41 | 4,905,540 | 5.4% | 17.4% |

| 5-gram | Word | 577,241 | 19.14 | 1,093,587 | 2.6% | 7.1% |

| 5-gram | Subword | 676,357 | 19.37 | 11,885,834 | 3.2% | 11.3% |

Top 5 N-grams by Size

2-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | พ ศ |

586,670 |

| 2 | ค ศ |

304,560 |

| 3 | อ้างอิง แหล่งข้อมูลอื่น |

46,447 |

| 4 | of the |

42,755 |

| 5 | ศ พ |

32,101 |

3-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ศ พ ศ |

31,957 |

| 2 | พ ศ พ |

27,195 |

| 3 | ศ ค ศ |

25,879 |

| 4 | ธันวาคม พ ศ |

21,330 |

| 5 | ตุลาคม พ ศ |

21,250 |

4-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | พ ศ พ ศ |

27,071 |

| 2 | พ ศ ค ศ |

20,164 |

| 3 | 0 0 0 0 |

7,943 |

| 4 | ค ศ ค ศ |

4,813 |

| 5 | อ้างอิง แหล่งข้อมูลอื่น พ ศ |

4,336 |

5-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ศ พ ศ พ ศ |

4,329 |

| 2 | พ ศ พ ศ พ |

4,251 |

| 3 | ศ พ ศ ค ศ |

3,779 |

| 4 | พ ศ พ ศ ค |

3,510 |

| 5 | 0 0 0 0 0 |

3,345 |

2-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | อ ง |

3,386,500 |

| 2 | า ร |

3,061,397 |

| 3 | ก า |

2,892,062 |

| 4 | ร ะ |

2,734,121 |

| 5 | น _ |

2,476,484 |

3-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ก า ร |

2,154,969 |

| 2 | เ ป็ น |

1,461,135 |

| 3 | แ ล ะ |

1,456,554 |

| 4 | ข อ ง |

1,220,921 |

| 5 | ป ร ะ |

1,178,596 |

4-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | . ศ . _ |

887,086 |

| 2 | _ แ ล ะ |

845,421 |

| 3 | พ . ศ . |

598,362 |

| 4 | _ พ . ศ |

554,703 |

| 5 | ค ว า ม |

480,722 |

5-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | พ . ศ . _ |

572,671 |

| 2 | _ พ . ศ . |

553,928 |

| 3 | ค . ศ . _ |

311,390 |

| 4 | _ ค . ศ . |

268,747 |

| 5 | ป ร ะ เ ท |

260,009 |

Key Findings

- Best Perplexity: 2-gram (subword) with 2,438

- Entropy Trend: Decreases with larger n-grams (more predictable)

- Coverage: Top-1000 patterns cover ~11% of corpus

- Recommendation: 4-gram or 5-gram for best predictive performance

3. Markov Chain Evaluation

Results

| Context | Variant | Avg Entropy | Perplexity | Branching Factor | Unique Contexts | Predictability |

|---|---|---|---|---|---|---|

| 1 | Word | 0.2321 | 1.175 | 2.38 | 8,268,387 | 76.8% |

| 1 | Subword | 0.8922 | 1.856 | 12.22 | 37,876 | 10.8% |

| 2 | Word | 0.1165 | 1.084 | 1.32 | 19,576,764 | 88.4% |

| 2 | Subword | 0.6125 | 1.529 | 5.30 | 462,626 | 38.7% |

| 3 | Word | 0.0518 | 1.037 | 1.11 | 25,779,145 | 94.8% |

| 3 | Subword | 0.5564 | 1.471 | 3.91 | 2,452,254 | 44.4% |

| 4 | Word | 0.0248 🏆 | 1.017 | 1.05 | 28,430,641 | 97.5% |

| 4 | Subword | 0.4718 | 1.387 | 2.77 | 9,576,634 | 52.8% |

Generated Text Samples (Word-based)

Below are text samples generated from each word-based Markov chain model:

Context Size 1:

ศ 829 575b 220 นั้นมีการใช้กระสุนที่จำกัด จึงผลิตปืนรุ่นนี้ออกมา และยังมีรุ่นย่อยคือ พี วีส์บิกแอดเว...พ ศ 12 12 34 1 พฤศจิกายน เมื่อวันที่ 16 ทีมสุดท้าย 8 เป็นต้นไป ค ศ เขายังได้ปีนข่านเทนกรี ในปี1 จัดเป็นสี่กลุ่ม กลุ่มละ 4 9 ศรีราชา อำเภอศรีราชา จังหวัดชลบุรี ในครอบครัวที่มีพี่น้อง 5 พฤษภาคม สิ...

Context Size 2:

พ ศ ได้รับอนุมัติจากมหาเถรสมาคมให้ปรับปรุงสภาพวัดให้ดีขึ้น ปี พ ศ ค ศ พระเจ้าอิชต์วานที่ 1 ประเทศฮัง...ค ศ ปัจจุบัน ละครชุด ปีเรื่องบทร่วมกับออกอากาศอ้างอิงพ ศ ความทรงจำที่ไม่อาจลืม ตอน บันทึกท่องเที่ยวท...of the usaf retrieved 20 october เจ้าชายโทโมฮิโตะแห่งมิกาซะสิ้นพระชนม์เมื่อวันที่ 6 มิถุนายน พ ศ อ้า...

Context Size 3:

พ ศ พ ศ และครั้งที่สอง ประมาณ พ ศ 31 สิงหาคม พ ศ วิทยาลัยโทรคมนาคมนนทบุรี รับนักศึกษาจาก การสอบคัดเล...ศ พ ศ ค ศ พระเจ้าแฟร์ดีนันท์ที่ 4 แห่งชาวโรมัน 8 กันยายน ค ศ เป็นที่รู้จักในชื่อ ไป๋ ลู่ เป็นนักแสดง...ศ ค ศ พระองค์เจ้าสุวพักตร์วิไลยพรรณ ประสูติ 2 พฤษภาคม พ ศ พ ศ ไอ จี คอมมิวนิเคชัน

Context Size 4:

พ ศ พ ศ เป็นปราชญ์และนักคิดอิสระที่ได้รับการกล่าวถึงอย่างกว้างขวาง เมื่อยังเป็นเด็กหนุ่ม ทางสมาคมเทว...พ ศ ค ศ ดีแลน มินเน็ตต์ นักแสดงและนักดนตรีชาวอเมริกัน ปรินซ์ แอมพอนซา นักฟุตบอลชาวกานา ซานะ มินาโตซา...0 0 0 0 ไมได้เข้าร่วมแข่งขัน 4 0 0 0 0 4 21 17 4 26 4 ระนอง 16 6

Generated Text Samples (Subword-based)

Below are text samples generated from each subword-based Markov chain model:

Context Size 1:

_คยงข_ในที่เป็นกอว่าารตียนผิดละคาระบโดนาณฑลาระปยีปดารรน

Context Size 2:

องครั้งที่รู้จักระชนิดนึงนิารไปส.ธ.90.0_ของเการสช.อีกครั้งมีว่า_เป

Context Size 3:

การใด_ๆ_broad_meteเป็นการใช้อย่างต่างจากและครั้งแรมชาติขึ้นบก_แ

Context Size 4:

.ศ._สหราชอาณาเขตจตุจั_และไม่สามารถป้องกันแลพ.ศ._76_<small>(ไทย

Key Findings

- Best Predictability: Context-4 (word) with 97.5% predictability

- Branching Factor: Decreases with context size (more deterministic)

- Memory Trade-off: Larger contexts require more storage (9,576,634 contexts)

- Recommendation: Context-3 or Context-4 for text generation

4. Vocabulary Analysis

Statistics

| Metric | Value |

|---|---|

| Vocabulary Size | 1,276,542 |

| Total Tokens | 26,332,909 |

| Mean Frequency | 20.63 |

| Median Frequency | 3 |

| Frequency Std Dev | 1261.31 |

Most Common Words

| Rank | Word | Frequency |

|---|---|---|

| 1 | ศ | 920,143 |

| 2 | พ | 595,465 |

| 3 | 1 | 351,475 |

| 4 | ค | 314,624 |

| 5 | 2 | 306,676 |

| 6 | 3 | 247,910 |

| 7 | the | 217,279 |

| 8 | 4 | 172,069 |

| 9 | ๆ | 171,685 |

| 10 | of | 169,227 |

Least Common Words (from vocabulary)

| Rank | Word | Frequency |

|---|---|---|

| 1 | เบอร์ลินฟาร์มาซูติคอลอินดัสตรี้ | 2 |

| 2 | มีเลขซีเทนขั้นต่ำที่ | 2 |

| 3 | น้ำมันดีเซลหมุนเวียน | 2 |

| 4 | neste | 2 |

| 5 | เฮกซาดีเคน | 2 |

| 6 | เฮปตาเมทิลโนเนน | 2 |

| 7 | เครื่องทดสอบคุณภาพการจุดระเบิด | 2 |

| 8 | เครื่องมือนี้ใช้วิธีเรียบง่ายกว่าและแข็งแกร่งกว่าในการวัดเลขซีเทนเมื่อเทียบกับ | 2 |

| 9 | บ้านเก้าเลี้ยว | 2 |

| 10 | ชุมชนบ้านเก้าเลี้ยว | 2 |

Zipf's Law Analysis

| Metric | Value |

|---|---|

| Zipf Coefficient | 0.9360 |

| R² (Goodness of Fit) | 0.999043 |

| Adherence Quality | excellent |

Coverage Analysis

| Top N Words | Coverage |

|---|---|

| Top 100 | 29.7% |

| Top 1,000 | 45.1% |

| Top 5,000 | 57.6% |

| Top 10,000 | 63.4% |

Key Findings

- Zipf Compliance: R²=0.9990 indicates excellent adherence to Zipf's law

- High Frequency Dominance: Top 100 words cover 29.7% of corpus

- Long Tail: 1,266,542 words needed for remaining 36.6% coverage

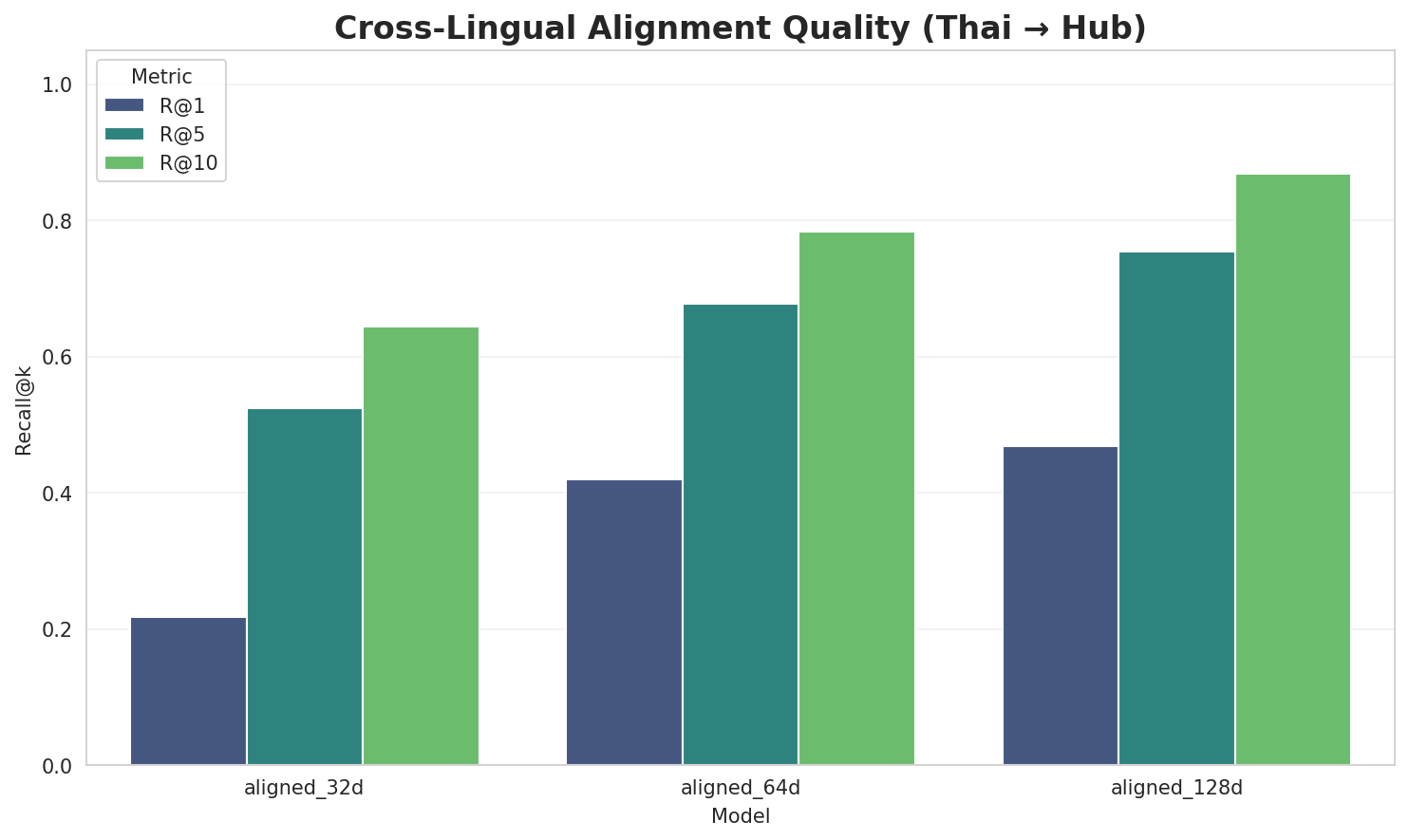

5. Word Embeddings Evaluation

5.1 Cross-Lingual Alignment

5.2 Model Comparison

| Model | Dimension | Isotropy | Semantic Density | Alignment R@1 | Alignment R@10 |

|---|---|---|---|---|---|

| mono_32d | 32 | 0.8475 | 0.3288 | N/A | N/A |

| mono_64d | 64 | 0.8400 | 0.2631 | N/A | N/A |

| mono_128d | 128 | 0.8225 | 0.1868 | N/A | N/A |

| aligned_32d | 32 | 0.8475 🏆 | 0.3296 | 0.2180 | 0.6440 |

| aligned_64d | 64 | 0.8400 | 0.2600 | 0.4200 | 0.7840 |

| aligned_128d | 128 | 0.8225 | 0.1907 | 0.4680 | 0.8680 |

Key Findings

- Best Isotropy: aligned_32d with 0.8475 (more uniform distribution)

- Semantic Density: Average pairwise similarity of 0.2598. Lower values indicate better semantic separation.

- Alignment Quality: Aligned models achieve up to 46.8% R@1 in cross-lingual retrieval.

- Recommendation: 128d aligned for best cross-lingual performance

6. Morphological Analysis (Experimental)

This section presents an automated morphological analysis derived from the statistical divergence between word-level and subword-level models. By analyzing where subword predictability spikes and where word-level coverage fails, we can infer linguistic structures without supervised data.

6.1 Productivity & Complexity

| Metric | Value | Interpretation | Recommendation |

|---|---|---|---|

| Productivity Index | 5.000 | High morphological productivity | Reliable analysis |

| Idiomaticity Gap | -0.367 | Low formulaic content | - |

6.2 Affix Inventory (Productive Units)

These are the most productive prefixes and suffixes identified by sampling the vocabulary for global substitutability patterns. A unit is considered an affix if stripping it leaves a valid stem that appears in other contexts.

Productive Prefixes

| Prefix | Examples |

|---|---|

-และ |

และได้รับแต่งตั้งเป็นรัฐมนตรีที่ไม่ประจำกระทรวง, และพาทีมเข้าชิงชนะเลิศ, และคริสต์ศาสนา |

-เ |

เจ้าเมืองนครเขื่อนขันธ์คนที่, เฉิงเตี๋ยอี, เวลวิชเซีย |

-โ |

โรงเรียนพระปฐมวิทยาลัย, โรงเรียนเวียงกาหลงวิทยา, โอมมอก |

-แ |

แม่เม็ง, และได้รับแต่งตั้งเป็นรัฐมนตรีที่ไม่ประจำกระทรวง, และพาทีมเข้าชิงชนะเลิศ |

-อ |

อควาครอส, อำเภอทุ่งยางแดง, อุดมศิลป์ |

-ส |

สมเด็จพระสันตะปาปาธีโอดอร์ที่, สถิรวํโส, สาขาวิชาศิลปกรรม |

-ก |

การลอบฆ่า, กาญจนพัฒน์, การประมูลคลื่น |

-ค |

คิคาวาดะ, คิดประเสริฐ, ครอบคลุมพื้นที่ตำบลสงยางทั้งตำบล |

Productive Suffixes

| Suffix | Examples |

|---|---|

-น |

ที่โด่งดังเช่น, ตั้งอยู่บนเชิงเทิน, นักเรียนห้องกิฟต์รุ่น |

-ง |

แม่เม็ง, และได้รับแต่งตั้งเป็นรัฐมนตรีที่ไม่ประจำกระทรวง, อำเภอทุ่งยางแดง |

-า |

การลอบฆ่า, โรงเรียนเวียงกาหลงวิทยา, อดีตนายกรัฐมนตรีแคนาดา |

-ย |

นำชัย, โรงเรียนพระปฐมวิทยาลัย, ชีวิตช่วงปลาย |

-ก |

ล้อมรอบด้วยกนกเปลวเพลิงด้านบนมีรัศมีประกอบแปดแฉก, โอมมอก, เนื่องในโอกาสพระราชพิธีกาญจนาภิเษก |

-ม |

หิมาลัยยิม, มอบโดยกระทรวงวัฒนธรรม, สาขาวิชาศิลปกรรม |

-อง |

และในคืนนั้นเอง, กาเอต็อง, นักแสดงจากเรื่อง |

-ร |

หงษ์ขจร, จะพูดถึงความรู้สึกเชื่อใจได้อย่างไร, และนายทหาร |

6.3 Bound Stems (Lexical Roots)

Bound stems are high-frequency subword units that are semantically cohesive but rarely appear as standalone words. These often correspond to the 'core' of a word that requires inflection or derivation to be valid.

| Stem | Cohesion | Substitutability | Examples |

|---|---|---|---|

การแ |

2.17x | 65 contexts | การแลก, การแปล, การแตก |

ของเ |

1.49x | 196 contexts | ของเล, ของเจ, ของเอ |

พระร |

2.07x | 33 contexts | พระรถ, พระราม, พระราช |

การเ |

1.55x | 93 contexts | การเย, การเดท, การเอา |

ศาสต |

1.82x | 46 contexts | ศาสตา, ศาสตรา, ศาสตร์ |

าการ |

1.45x | 100 contexts | อาการ, บาการี, คาการิ |

นการ |

1.48x | 86 contexts | ธนการ, ในการ, แผนการ |

ประก |

1.46x | 84 contexts | ประกบ, ประการ, ประกิจ |

โรงเ |

2.92x | 8 contexts | โรงเจ, โรงเข้, โรงเรีย |

ประเ |

1.42x | 83 contexts | ประเถท, ประเภท, ประเทศ |

งจาก |

1.44x | 72 contexts | บางจาก, อิงจาก, ทางจาก |

ระเท |

1.66x | 38 contexts | กระเทย, กระเทศ, พระเทพ |

6.4 Affix Compatibility (Co-occurrence)

This table shows which prefixes and suffixes most frequently co-occur on the same stems, revealing the 'stacking' rules of the language's morphology.

| Prefix | Suffix | Frequency | Examples |

|---|---|---|---|

-เ |

-น |

101 words | เพื่อเป็นการรักษากำลังและไพร่พลทหารของตนเองไว้สำหรับการศึกอื่น, เหยาจื่อจิน |

-เ |

-ง |

84 words | เธอได้ออกเพลง, เจิ้นเสียง |

-เ |

-า |

80 words | เข็มข้าหลวงเดิมราชกิจจานุเบกษา, เจ้าหญิงโรมานอฟสกายา |

-เ |

-ย |

53 words | เป็นภาษาไทยอีกด้วย, เพลงดาบแม่น้ำร้อยสาย |

-และ |

-น |

52 words | และตำบลบ้านแหวน, และเปลี่ยนชื่อไปเป็น |

-โ |

-ง |

50 words | โดยใช้เครื่องบินโบอิง, โรงเรียนตะโกดอนหญ้านาง |

-โ |

-น |

45 words | โคเฮ็น, โฟกส์วาเกน |

-ก |

-น |

44 words | กุลธน, การแบ่งชนชั้น |

-โ |

-า |

42 words | โรงเรียนศรีสมบูรณ์วิทยา, โดยมีวัตถุประสงค์เพื่อเป็นสถาบันการศึกษา |

-แ |

-น |

41 words | และตำบลบ้านแหวน, แม่ฮ่องสอน |

6.5 Recursive Morpheme Segmentation

Using Recursive Hierarchical Substitutability, we decompose complex words into their constituent morphemes. This approach handles nested affixes (e.g., prefix-prefix-root-suffix).

| Word | Suggested Split | Confidence | Stem |

|---|---|---|---|

| การทำคะแนน | การทำคะแ-น-น |

7.5 | น |

| เจ้าจอมสุวัทนา | เจ้าจอมสุวัท-น-า |

7.5 | น |

| หัวอกชาวนา | หัวอกชาว-น-า |

7.5 | น |

| อิริยาปถบรรพ | อิริยาปถบร-ร-พ |

7.5 | ร |

| ตำบลพลวงสองนาง | ตำบลพลวงสอง-น-าง |

7.5 | น |

| เส้นทางทรนง | เส้นทางทร-น-ง |

7.5 | น |

| อเล็กซานดรอฟนา | อเล็กซานดรอฟ-น-า |

7.5 | น |

| คาจิโดกิอาร์มส | คาจิโดกิอาร์-ม-ส |

7.5 | ม |

| และเซเรนา | และเซเร-น-า |

7.5 | น |

| และคูลลิแนน | และคูลลิแ-น-น |

7.5 | น |

| ฟุชิกิดาเนะ | ฟุชิกิดาเ-น-ะ |

7.5 | น |

| ตำบลม่วงงาม | ตำบลม่วง-ง-าม |

6.0 | ตำบลม่วง |

| และตำบลหมื่นไวย | และ-ตำบลหมื่นไวย |

4.5 | ตำบลหมื่นไวย |

| และได้รับสมญาว่า | และ-ได้รับสมญาว่า |

4.5 | ได้รับสมญาว่า |

| และประทับอยู่ | และ-ประทับอยู่ |

4.5 | ประทับอยู่ |

6.6 Linguistic Interpretation

Automated Insight: The language Thai shows high morphological productivity. The subword models are significantly more efficient than word models, suggesting a rich system of affixation or compounding.

7. Summary & Recommendations

Production Recommendations

| Component | Recommended | Rationale |

|---|---|---|

| Tokenizer | 64k BPE | Best compression (4.75x) |

| N-gram | 2-gram | Lowest perplexity (2,438) |

| Markov | Context-4 | Highest predictability (97.5%) |

| Embeddings | 100d | Balanced semantic capture and isotropy |

Appendix: Metrics Glossary & Interpretation Guide

This section provides definitions, intuitions, and guidance for interpreting the metrics used throughout this report.

Tokenizer Metrics

Compression Ratio

Definition: The ratio of characters to tokens (chars/token). Measures how efficiently the tokenizer represents text.

Intuition: Higher compression means fewer tokens needed to represent the same text, reducing sequence lengths for downstream models. A 3x compression means ~3 characters per token on average.

What to seek: Higher is generally better for efficiency, but extremely high compression may indicate overly aggressive merging that loses morphological information.

Average Token Length (Fertility)

Definition: Mean number of characters per token produced by the tokenizer.

Intuition: Reflects the granularity of tokenization. Longer tokens capture more context but may struggle with rare words; shorter tokens are more flexible but increase sequence length.

What to seek: Balance between 2-5 characters for most languages. Arabic/morphologically-rich languages may benefit from slightly longer tokens.

Unknown Token Rate (OOV Rate)

Definition: Percentage of tokens that map to the unknown/UNK token, indicating words the tokenizer cannot represent.

Intuition: Lower OOV means better vocabulary coverage. High OOV indicates the tokenizer encounters many unseen character sequences.

What to seek: Below 1% is excellent; below 5% is acceptable. BPE tokenizers typically achieve very low OOV due to subword fallback.

N-gram Model Metrics

Perplexity

Definition: Measures how "surprised" the model is by test data. Mathematically: 2^(cross-entropy). Lower values indicate better prediction.

Intuition: If perplexity is 100, the model is as uncertain as if choosing uniformly among 100 options at each step. A perplexity of 10 means effectively choosing among 10 equally likely options.

What to seek: Lower is better. Perplexity decreases with larger n-grams (more context). Values vary widely by language and corpus size.

Entropy

Definition: Average information content (in bits) needed to encode the next token given the context. Related to perplexity: perplexity = 2^entropy.

Intuition: High entropy means high uncertainty/randomness; low entropy means predictable patterns. Natural language typically has entropy between 1-4 bits per character.

What to seek: Lower entropy indicates more predictable text patterns. Entropy should decrease as n-gram size increases.

Coverage (Top-K)

Definition: Percentage of corpus occurrences explained by the top K most frequent n-grams.

Intuition: High coverage with few patterns indicates repetitive/formulaic text; low coverage suggests diverse vocabulary usage.

What to seek: Depends on use case. For language modeling, moderate coverage (40-60% with top-1000) is typical for natural text.

Markov Chain Metrics

Average Entropy

Definition: Mean entropy across all contexts, measuring average uncertainty in next-word prediction.

Intuition: Lower entropy means the model is more confident about what comes next. Context-1 has high entropy (many possible next words); Context-4 has low entropy (few likely continuations).

What to seek: Decreasing entropy with larger context sizes. Very low entropy (<0.1) indicates highly deterministic transitions.

Branching Factor

Definition: Average number of unique next tokens observed for each context.

Intuition: High branching = many possible continuations (flexible but uncertain); low branching = few options (predictable but potentially repetitive).

What to seek: Branching factor should decrease with context size. Values near 1.0 indicate nearly deterministic chains.

Predictability

Definition: Derived metric: (1 - normalized_entropy) × 100%. Indicates how deterministic the model's predictions are.

Intuition: 100% predictability means the next word is always certain; 0% means completely random. Real text falls between these extremes.

What to seek: Higher predictability for text generation quality, but too high (>98%) may produce repetitive output.

Vocabulary & Zipf's Law Metrics

Zipf's Coefficient

Definition: The slope of the log-log plot of word frequency vs. rank. Zipf's law predicts this should be approximately -1.

Intuition: A coefficient near -1 indicates the corpus follows natural language patterns where a few words are very common and most words are rare.

What to seek: Values between -0.8 and -1.2 indicate healthy natural language distribution. Deviations may suggest domain-specific or artificial text.

R² (Coefficient of Determination)

Definition: Measures how well the linear fit explains the frequency-rank relationship. Ranges from 0 to 1.

Intuition: R² near 1.0 means the data closely follows Zipf's law; lower values indicate deviation from expected word frequency patterns.

What to seek: R² > 0.95 is excellent; > 0.99 indicates near-perfect Zipf adherence typical of large natural corpora.

Vocabulary Coverage

Definition: Cumulative percentage of corpus tokens accounted for by the top N words.

Intuition: Shows how concentrated word usage is. If top-100 words cover 50% of text, the corpus relies heavily on common words.

What to seek: Top-100 covering 30-50% is typical. Higher coverage indicates more repetitive text; lower suggests richer vocabulary.

Word Embedding Metrics

Isotropy

Definition: Measures how uniformly distributed vectors are in the embedding space. Computed as the ratio of minimum to maximum singular values.

Intuition: High isotropy (near 1.0) means vectors spread evenly in all directions; low isotropy means vectors cluster in certain directions, reducing expressiveness.

What to seek: Higher isotropy generally indicates better-quality embeddings. Values > 0.1 are reasonable; > 0.3 is good. Lower-dimensional embeddings tend to have higher isotropy.

Average Norm

Definition: Mean magnitude (L2 norm) of word vectors in the embedding space.

Intuition: Indicates the typical "length" of vectors. Consistent norms suggest stable training; high variance may indicate some words are undertrained.

What to seek: Relatively consistent norms across models. The absolute value matters less than consistency (low std deviation).

Cosine Similarity

Definition: Measures angular similarity between vectors, ranging from -1 (opposite) to 1 (identical direction).

Intuition: Words with similar meanings should have high cosine similarity. This is the standard metric for semantic relatedness in embeddings.

What to seek: Semantically related words should score > 0.5; unrelated words should be near 0. Synonyms often score > 0.7.

t-SNE Visualization

Definition: t-Distributed Stochastic Neighbor Embedding - a dimensionality reduction technique that preserves local structure for visualization.

Intuition: Clusters in t-SNE plots indicate groups of semantically related words. Spread indicates vocabulary diversity; tight clusters suggest semantic coherence.

What to seek: Meaningful clusters (e.g., numbers together, verbs together). Avoid over-interpreting distances - t-SNE preserves local, not global, structure.

General Interpretation Guidelines

- Compare within model families: Metrics are most meaningful when comparing models of the same type (e.g., 8k vs 64k tokenizer).

- Consider trade-offs: Better performance on one metric often comes at the cost of another (e.g., compression vs. OOV rate).

- Context matters: Optimal values depend on downstream tasks. Text generation may prioritize different metrics than classification.

- Corpus influence: All metrics are influenced by corpus characteristics. Wikipedia text differs from social media or literature.

- Language-specific patterns: Morphologically rich languages (like Arabic) may show different optimal ranges than analytic languages.

Visualizations Index

| Visualization | Description |

|---|---|

| Tokenizer Compression | Compression ratios by vocabulary size |

| Tokenizer Fertility | Average token length by vocabulary |

| Tokenizer OOV | Unknown token rates |

| Tokenizer Total Tokens | Total tokens by vocabulary |

| N-gram Perplexity | Perplexity by n-gram size |

| N-gram Entropy | Entropy by n-gram size |

| N-gram Coverage | Top pattern coverage |

| N-gram Unique | Unique n-gram counts |

| Markov Entropy | Entropy by context size |

| Markov Branching | Branching factor by context |

| Markov Contexts | Unique context counts |

| Zipf's Law | Frequency-rank distribution with fit |

| Vocab Frequency | Word frequency distribution |

| Top 20 Words | Most frequent words |

| Vocab Coverage | Cumulative coverage curve |

| Embedding Isotropy | Vector space uniformity |

| Embedding Norms | Vector magnitude distribution |

| Embedding Similarity | Word similarity heatmap |

| Nearest Neighbors | Similar words for key terms |

| t-SNE Words | 2D word embedding visualization |

| t-SNE Sentences | 2D sentence embedding visualization |

| Position Encoding | Encoding method comparison |

| Model Sizes | Storage requirements |

| Performance Dashboard | Comprehensive performance overview |

About This Project

Data Source

Models trained on wikipedia-monthly - a monthly snapshot of Wikipedia articles across 300+ languages.

Project

A project by Wikilangs - Open-source NLP models for every Wikipedia language.

Maintainer

Citation

If you use these models in your research, please cite:

@misc{wikilangs2025,

author = {Kamali, Omar},

title = {Wikilangs: Open NLP Models for Wikipedia Languages},

year = {2025},

doi = {10.5281/zenodo.18073153},

publisher = {Zenodo},

url = {https://huggingface.co/wikilangs}

institution = {Omneity Labs}

}

License

MIT License - Free for academic and commercial use.

Links

- 🌐 Website: wikilangs.org

- 🤗 Models: huggingface.co/wikilangs

- 📊 Data: wikipedia-monthly

- 👤 Author: Omar Kamali

- 🤝 Sponsor: Featherless AI

Generated by Wikilangs Models Pipeline

Report Date: 2026-01-17 15:56:15